清华大学人工智能芯片研究报告 从硬件基石到软件生态的全面解析与发展展望

随着人工智能(AI)技术的迅猛发展,作为其物理载体的AI芯片已成为推动产业变革的核心引擎。本报告旨在全面讲解人工智能芯片的技术原理、架构分类,系统梳理其发展现状,并深入探讨未来趋势及其对人工智能应用软件开发的深远影响。

一、人工智能芯片技术全景解析

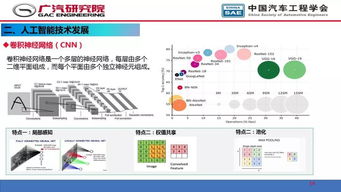

人工智能芯片,特指为加速人工智能算法(尤其是机器学习中的矩阵运算、卷积计算、深度学习等)而设计或优化的专用处理器。其核心目标在于高效处理海量数据,实现低延迟、高能效的智能计算。

主要架构类型包括:

1. 图形处理器(GPU):凭借其强大的并行计算能力和成熟的生态(如CUDA),GPU是当前AI训练与推理的绝对主力,尤其在数据中心领域。

2. 专用集成电路(ASIC):为特定AI算法或场景(如语音识别、自动驾驶)定制的芯片,如谷歌的TPU、寒武纪的思元系列。其特点是能效比和计算密度极高,但灵活性较低,研发成本高。

3. 现场可编程门阵列(FPGA):具备硬件可重构特性,可在算法迭代中快速调整,在原型验证和特定边缘计算场景中优势显著。

4. 神经拟态芯片:受生物大脑启发的非冯·诺依曼架构芯片,通过模拟神经元与突触的行为进行事件驱动型计算,有望在能效上实现突破,如英特尔Loihi。

二、发展现状与竞争格局

当前,AI芯片产业已形成多元化竞争态势:

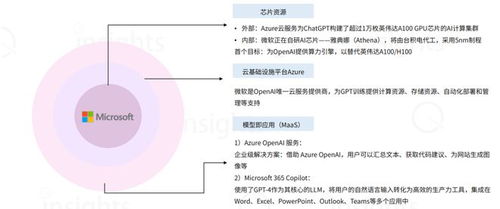

- 国际巨头领跑:英伟达凭借其GPU和CUDA生态构建了极高的壁垒;谷歌、亚马逊、微软等云服务商自研ASIC(如TPU v4, Trainium, Inferentia)以优化自身云服务成本与性能;英特尔通过收购(如Altera, Habana Labs)整合FPGA与ASIC能力。

- 中国力量崛起:以华为昇腾、寒武纪、地平线、阿里巴巴平头哥等为代表的中国企业,在端侧、边缘侧及云侧芯片领域取得系列突破,构建自主技术体系与生态成为核心战略。

- 学术前沿探索:以清华大学、斯坦福大学等顶尖高校为代表的科研机构,在存算一体、光计算、量子计算等下一代AI芯片技术上持续开展前沿探索,为长远发展储备技术。

三、核心发展趋势展望

- 架构创新持续深入:超越传统冯·诺依曼架构的“存算一体”技术旨在突破“内存墙”瓶颈,将计算单元嵌入存储器,极大减少数据搬运能耗,是未来高能效芯片的重要方向。

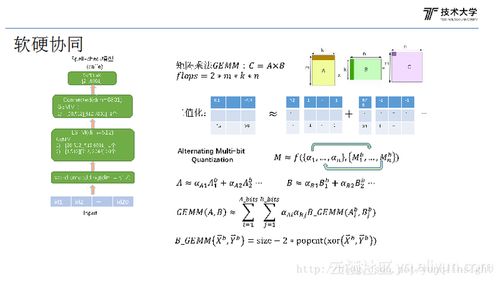

- 软硬件协同设计成为主流:芯片设计与上层算法、框架、编译器的协同优化愈发关键。如“芯片定义软件”与“软件定义芯片”的融合,通过软硬件联合优化释放最大性能。

- 场景化与垂直整合:针对自动驾驶、机器人、科学计算、生物医药等不同垂直领域,定制化、场景化的AI芯片解决方案将不断涌现,实现性能与能效的最优解。

- 生态建设决定成败:芯片的成功不仅取决于硬件指标,更依赖于其支撑的软件栈、开发工具、模型库及开发者社区。构建开放、易用、高效的软硬件一体生态是竞争焦点。

四、对人工智能应用软件开发的深刻影响

AI芯片的演进正从根本上重塑应用软件开发范式:

- 开发门槛降低与效率提升:高性能、专用化的AI芯片,配合成熟的模型框架(如PyTorch, TensorFlow)和优化工具链,使得开发者能更专注于算法创新与应用逻辑,无需过度关注底层硬件细节。

- 部署场景极大拓展:从云端向边缘端、终端设备的延伸,使得AI能力能够嵌入手机、IoT设备、汽车、工厂等任何场景,催生出实时性、隐私保护要求更高的新型应用软件。

- 模型设计与优化方向变革:芯片的特性反向影响算法设计。例如,为适应边缘芯片的有限算力和内存,模型轻量化(如剪枝、量化、知识蒸馏)、神经架构搜索(NAS)等技术变得至关重要。

- 软硬件协同优化成为关键技能:顶尖的AI应用开发团队需要理解目标硬件的架构特性(如内存层次、计算单元),进行针对性的模型优化与编译器调优,以榨取硬件极限性能。

结论

人工智能芯片是智能时代的算力基石,其发展正沿着架构创新、软硬件协同、场景深化和生态构建的路径快速演进。对于人工智能应用软件开发而言,这既意味着更强大的工具和更广阔的空间,也带来了适应异构算力、进行深度优化的新挑战。成功的AI应用将必然是顶尖算法、高效软件与强大芯片三者深度融合的产物。产学研各界需加强协作,共同推动从底层硬件到上层应用的自主创新与生态繁荣,以夯实国家在人工智能时代的核心竞争力。

如若转载,请注明出处:http://www.wgame18.com/product/13.html

更新时间:2026-05-22 16:47:22